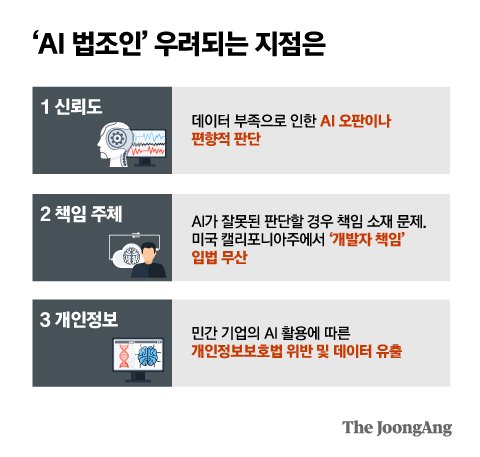

① 때아닌 챗GPT 공방은 국정감사의 이색 풍경 중 하나로 소개됐지만, 실상은 ‘AI 법조인’ 시대의 쟁점이 그대로 담긴 장면이라는 평가가 나온다. AI에게 법적인 판단을 구하고 그 답변을 주장의 근거로 활용하는 상황이 국회에서 펼쳐졌다는 점에서다. 다만 실제 ‘AI 법조인’ 시대가 실현되기까지는 해결해야 할 과제가 산적해 있다.

② 가장 큰 문제는 법률AI를 신뢰할 수 있는가다. AI가 가짜 정보를 진짜인 것처럼 제공하는 이른바 ‘환각(hallucination) 현상’은 지난 3월 미국 법조계에서 실제 발생했다. 한 변호사가 AI가 만들어낸 판례를 인용해 제출했다가 미국 플로리다주 중부 지방법원으로부터 1년 정직 처분을 받으면서다.

③ ‘환각’을 막고 답변의 정확성을 높이려면 판결문을 많이 학습시켜야 하는데, 한국 법원의 판결문 공개율이 30%대라는 점은 선결 과제다. 법원은 현재 ‘종합법률정보시스템’과 ‘판결서 인터넷 열람 제도’를 통해서 판결문을 공개하고 있는데, 공개 판결문의 범위는 형사는 2013년 이후 확정된 판결, 민사(가사·행정·특허 포함)는 2015년 이후 확정된 판결로 제한된다.

④ “AI엔진이 자동차의 엔진이라면 판례는 휘발유다. 연료가 없으면 엔진이 못 굴러가는 것과 마찬가지”라며 안타까워했다. 그러면서 “개인정보보호법 등 여러 현행법이 걸림돌이 되고 있다. 법원에서 모든 데이터를 전자화시킨 지 오래된 만큼, 국회에서 판결문 공개를 위해 입법적으로 따라와줘야 한다”고 지적했다.

⑤ 정보보안과 개인정보보호법 문제는 보다 가까이 닥친 걸림돌이다. 법원에서 자체 AI 시스템을 활용할 때는 재판 업무를 위해 판결문을 활용할 수 있다는 근거 규정이 있지만, 로펌 등에서 판결문을 활용할 때는 문제가 달라진다. “오픈AI 등 AI엔진이 대부분 해외 서버 기반인데, AI 엔진에 민감한 사법 정보를 올려도 안전하냐”는 것이다.

'코난의 5줄 기사 요약' 카테고리의 다른 글

| AI가 노벨상 휩쓸어 (10) | 2024.10.22 |

|---|---|

| 빌리어네어 보이즈클럽 (8) | 2024.10.22 |

| 자산의 서식지를 이동하라 (6) | 2024.10.21 |

| 초일류 문화강국된 한국 (8) | 2024.10.21 |

| 노벨문학상 220 대 1 경쟁서 시작! (6) | 2024.10.21 |